ChatGPT

- Thread starter Ikarus87

- Start date

Oh man... Das geht alles so verdammt schnell.

Ich bin ja echt ein Technik Freak, aber geht wirklich zu schnell und zu heftig. Wenn das mal gut geht.

P.s. ich hab heute mit gpt4 arbeitstexte machen lassen, die ich hätte selbst erstellen müssen.

Arbeit in Minuten fertig statt Stunden. Nur Kontrolle, bisschen was ändern oder kürzen.

Wilde Welt.

Ich bin ja echt ein Technik Freak, aber geht wirklich zu schnell und zu heftig. Wenn das mal gut geht.

P.s. ich hab heute mit gpt4 arbeitstexte machen lassen, die ich hätte selbst erstellen müssen.

Arbeit in Minuten fertig statt Stunden. Nur Kontrolle, bisschen was ändern oder kürzen.

Wilde Welt.

Zuletzt editiert:

Ja das wird noch lustig aber für mache halt einfach nicht wenn die Arbeitsstelle wegbricht. Für meinen Alltag finde ich eigentlich fast überhaut keine Anwendungsmöglichkeiten, was echt schade ist. Bin ja wirklich Technik affin. Ende des Jahres sollen ja die ersten Endgeräte mit AI rauskommen so ein live Übersetzer wäre wirklich eine super geile Sache, dann würde ich mir den Babelfisch sparen können.

-

PSN-Name: Der_Hutmacher

Ich warte schon darauf, dass jemand seine Diplomarbeit mit einem solchen Werkzeug erstellt. Ich sehe nur die Gefahr einer kollektiven "Verblödung", weil man einfach die Fähigkeit verliert, selbst zu recherchieren und einen Sachverhalt zu lösen. Es ist was anderes, wenn man sich nur Arbeit abnimmt, weil es nur lästiges "doing" wäre es selbst umzusetzen.

-

PSN-Name: Der_Hutmacher

Die Argumente gab es beim Taschenrechner wahrscheinlich auch

Aber ich merke auch an mir selbst, dass man sich dank des Smartphones z.B. gar nicht mehr die Mühe macht, auf seine Umgebung zu achten oder sich zu orientieren, wenn GoogleMaps nur einen Klick und einen Blick nach unten auf das Smartphone entfernt ist.

Aber ich merke auch an mir selbst, dass man sich dank des Smartphones z.B. gar nicht mehr die Mühe macht, auf seine Umgebung zu achten oder sich zu orientieren, wenn GoogleMaps nur einen Klick und einen Blick nach unten auf das Smartphone entfernt ist.

Nun kann man davon ausgehen das die ganze AI-Revolution zu mehr Dummheit führen könnte, was in manchen Bereichen vielleicht auch so sein wird. Gleichzeitig kann es aber auch dazu führen das man Leuten hilft und gleiche Chancen bietet. Wenn ChatGPT nun eine Bewerbung schreiben kann, die ohne Rechtschreibfehler oder so daherkommt, hilft das eben. Genauso könnten solche Leute dann auch in Jobs arbeiten, die vorher undenkbar waren, weil Grammatik oder Rechtschreibung nicht auf dem gewünschten Niveau sind.

Das ist IMHO alles nicht so schwarz/weiß zu sehen. Es gibt gute Entwicklungen dadurch und wahrscheinlich auch schlechte, die Frage ist nur wie man damit umgeht und wie man das regulieren kann.

https://mixed.de/skyrim-vr-mod-chatgpt/

Ich glaub da kommt irgendwann mal was ganz großes auf uns zu, und ja da werden ein paar leute drauf hängen bleiben wie bei wow damals...

Ich glaub da kommt irgendwann mal was ganz großes auf uns zu, und ja da werden ein paar leute drauf hängen bleiben wie bei wow damals...

-

PSN-Name: Der_Hutmacher

Ich habe nun auch mit den "Offline"-Modellen von Stable-Diffusion (Interface für Text2Image Generator) oder LLaMA (Interface für Chat GPT Derivat) experimentiert, die lokal auf dem eigenen Computer laufen, und es ist wirklich cool, was alles möglich ist.

Hintergrund: Kürzlich wurde das ChatGPT-Gegenstück von Facebook (LLaMA) geleakt und inzwischen gibt es "optimierte" Derivate, die es ermöglichen, diese Modelle auf Consumer-Hardware zu Hause laufen zu lassen.

Es ist wirklich spannend zu sehen, wohin die Reise gehen wird. Und ja, zum Beispiel: Gerade im Gaming Bereich wird es spannend sein zu sehen, wie diese Formen der AI in NPCs implementiert werden können. Allerdings sehe ich auch Probleme mit der notwendigen Performance, um das alles "lokal" zu simulieren. Da die notwendigen Ressourcen alleine "einen" Chatbot lokal laufen zu lassen, quasi schon die gesamten Ressourcen (CPU/GPU) in Anspruch nehmen. Ich kann es auf meinem Rechner sehen, wo ein Modell fast die gesamten 24GB VRAM der Grafikkarte verbraucht, nur um einen Chatbot zu simulieren. Nun ein ganzes Spiel mit X NPCs die in Realtime reagieren lokal auf Konsole oder PC? Never ever (vielleicht aber wenn man mit kleineren Modellen arbeitet?).

Dies ist eher ein Thema für Cloud-Gaming, das damit wieder an Fahrt aufnehmen könnte.

Hintergrund: Kürzlich wurde das ChatGPT-Gegenstück von Facebook (LLaMA) geleakt und inzwischen gibt es "optimierte" Derivate, die es ermöglichen, diese Modelle auf Consumer-Hardware zu Hause laufen zu lassen.

Es ist wirklich spannend zu sehen, wohin die Reise gehen wird. Und ja, zum Beispiel: Gerade im Gaming Bereich wird es spannend sein zu sehen, wie diese Formen der AI in NPCs implementiert werden können. Allerdings sehe ich auch Probleme mit der notwendigen Performance, um das alles "lokal" zu simulieren. Da die notwendigen Ressourcen alleine "einen" Chatbot lokal laufen zu lassen, quasi schon die gesamten Ressourcen (CPU/GPU) in Anspruch nehmen. Ich kann es auf meinem Rechner sehen, wo ein Modell fast die gesamten 24GB VRAM der Grafikkarte verbraucht, nur um einen Chatbot zu simulieren. Nun ein ganzes Spiel mit X NPCs die in Realtime reagieren lokal auf Konsole oder PC? Never ever (vielleicht aber wenn man mit kleineren Modellen arbeitet?).

Dies ist eher ein Thema für Cloud-Gaming, das damit wieder an Fahrt aufnehmen könnte.

ich habe auch lokal ein paar modelle laufen. leider nur das 7b weil mein vram zu klein ist.

Aber ich benutze gerade die OpenAI API in Verbindung mit https://github.com/suno-ai/bark um mir aus ebooks Hörbücher zu generieren.

Bin noch am experimentieren, aber PoC läuft schonmal.

Mit ner besseren GPU werde ich dann den API Teil auch mit lokalem llama versuchen.

Muss mich nur grad noch überzeugen nen neuen Rechner mit 4090 zu kaufen..

@Hutmacher

Hört sich so an als hätts du ne 4090.

Kanns du mir mal nen gefallen tun und testen was aus diesem prompt rausfällt:

oder , je nach modell auch eher diesen prompt:

Aber ich benutze gerade die OpenAI API in Verbindung mit https://github.com/suno-ai/bark um mir aus ebooks Hörbücher zu generieren.

Bin noch am experimentieren, aber PoC läuft schonmal.

Mit ner besseren GPU werde ich dann den API Teil auch mit lokalem llama versuchen.

Muss mich nur grad noch überzeugen nen neuen Rechner mit 4090 zu kaufen..

@Hutmacher

Hört sich so an als hätts du ne 4090.

Kanns du mir mal nen gefallen tun und testen was aus diesem prompt rausfällt:

Convert the following text into a list of all individual sentences, make a new line for each sentence. Dont write anything else in your response:

"Solaris" is a 1961 science fiction novel by Polish writer Stanisław Lem, which explores themes of consciousness, communication, and the human condition. The story is set in a distant future where humanity has achieved interstellar travel and made contact with extraterrestrial life forms. The novel follows psychologist Dr. Kris Kelvin, who is sent to investigate the mysterious occurrences at a remote research station orbiting the planet Solaris. Solaris is an oceanic world covered by a single, sentient ocean, capable of manipulating matter and energy, which has been studied by scientists for decades. Upon arrival, Kelvin discovers that the crew members are experiencing vivid hallucinations, conjured up by the planet's enigmatic ocean. Kelvin soon encounters his own hallucination: a perfect replica of his deceased wife, Rheya. As he interacts with the apparition, Kelvin realizes that she is a physical manifestation of his memories and guilt, created by the planet's ocean to communicate with the humans. The crew's hallucinations, referred to as "visitors," have been generated by the ocean as a result of its attempts to understand human psychology. The novel delves into the ethical dilemmas surrounding the visitors, as they are not fully human but still display emotions and consciousness. Kelvin struggles with his feelings for Rheya's replica and the implications of her existence.

"Solaris" is a 1961 science fiction novel by Polish writer Stanisław Lem, which explores themes of consciousness, communication, and the human condition. The story is set in a distant future where humanity has achieved interstellar travel and made contact with extraterrestrial life forms. The novel follows psychologist Dr. Kris Kelvin, who is sent to investigate the mysterious occurrences at a remote research station orbiting the planet Solaris. Solaris is an oceanic world covered by a single, sentient ocean, capable of manipulating matter and energy, which has been studied by scientists for decades. Upon arrival, Kelvin discovers that the crew members are experiencing vivid hallucinations, conjured up by the planet's enigmatic ocean. Kelvin soon encounters his own hallucination: a perfect replica of his deceased wife, Rheya. As he interacts with the apparition, Kelvin realizes that she is a physical manifestation of his memories and guilt, created by the planet's ocean to communicate with the humans. The crew's hallucinations, referred to as "visitors," have been generated by the ocean as a result of its attempts to understand human psychology. The novel delves into the ethical dilemmas surrounding the visitors, as they are not fully human but still display emotions and consciousness. Kelvin struggles with his feelings for Rheya's replica and the implications of her existence.

BEGIN OF TEXT

_______________

"Solaris" is a 1961 science fiction novel by Polish writer Stanisław Lem, which explores themes of consciousness, communication, and the human condition. The story is set in a distant future where humanity has achieved interstellar travel and made contact with extraterrestrial life forms. The novel follows psychologist Dr. Kris Kelvin, who is sent to investigate the mysterious occurrences at a remote research station orbiting the planet Solaris. Solaris is an oceanic world covered by a single, sentient ocean, capable of manipulating matter and energy, which has been studied by scientists for decades. Upon arrival, Kelvin discovers that the crew members are experiencing vivid hallucinations, conjured up by the planet's enigmatic ocean. Kelvin soon encounters his own hallucination: a perfect replica of his deceased wife, Rheya. As he interacts with the apparition, Kelvin realizes that she is a physical manifestation of his memories and guilt, created by the planet's ocean to communicate with the humans. The crew's hallucinations, referred to as "visitors," have been generated by the ocean as a result of its attempts to understand human psychology. The novel delves into the ethical dilemmas surrounding the visitors, as they are not fully human but still display emotions and consciousness. Kelvin struggles with his feelings for Rheya's replica and the implications of her existence.

__________________

END OF TEXT

The individual sentences from the above text, each in a seperate line, are:

_______________

"Solaris" is a 1961 science fiction novel by Polish writer Stanisław Lem, which explores themes of consciousness, communication, and the human condition. The story is set in a distant future where humanity has achieved interstellar travel and made contact with extraterrestrial life forms. The novel follows psychologist Dr. Kris Kelvin, who is sent to investigate the mysterious occurrences at a remote research station orbiting the planet Solaris. Solaris is an oceanic world covered by a single, sentient ocean, capable of manipulating matter and energy, which has been studied by scientists for decades. Upon arrival, Kelvin discovers that the crew members are experiencing vivid hallucinations, conjured up by the planet's enigmatic ocean. Kelvin soon encounters his own hallucination: a perfect replica of his deceased wife, Rheya. As he interacts with the apparition, Kelvin realizes that she is a physical manifestation of his memories and guilt, created by the planet's ocean to communicate with the humans. The crew's hallucinations, referred to as "visitors," have been generated by the ocean as a result of its attempts to understand human psychology. The novel delves into the ethical dilemmas surrounding the visitors, as they are not fully human but still display emotions and consciousness. Kelvin struggles with his feelings for Rheya's replica and the implications of her existence.

__________________

END OF TEXT

The individual sentences from the above text, each in a seperate line, are:

Zuletzt editiert:

-

PSN-Name: Der_Hutmacher

ich habe auch lokal ein paar modelle laufen. leider nur das 7b weil mein vram zu klein ist.

Aber ich benutze gerade die OpenAI API in Verbindung mit https://github.com/suno-ai/bark um mir aus ebooks Hörbücher zu generieren.

@Hutmacher

Hört sich so an als hätts du ne 4090.

Aber ich benutze gerade die OpenAI API in Verbindung mit https://github.com/suno-ai/bark um mir aus ebooks Hörbücher zu generieren.

@Hutmacher

Hört sich so an als hätts du ne 4090.

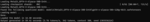

Hier der Output:

Laufzeit ca. 60 Sekunden

Verwendet habe ich dieses Model: https://huggingface.co/MetaIX/GPT4-X-Alpaca-30B-4bit

Es gibt auch zahlreiche Extensions Text2Speech und seit neustem sogar LLaVA (Large Language and Vision Assistant) Support.

Sehr geil! Vielen Dank.

Damit ist wohl klar dass ich demächst bestellen muss.

ja mit dem voice part bin ich auch noch am rumprobieren.

Interessant (und damit auch legally mindestens grey) wirds dann damit:

https://github.com/serp-ai/bark-with-voice-clone

Endlich mehr Hörbücher gelesen von Detlef Bierstedt

Aber mein Vorhaben ist auf jedenfall machbar.

Interesant wirds wenn ich versuche deutsche Hörbücher aus Büchern zu erstellen die es nur auf englisch gibt.

Zum Thema ressourcenverbrauch.

Letztens noch was von nvidia gelesen, Sie erwarten bis 2030, durch verbesserungen in hardware, software und dem ganzen Ökosystem eine Verbesserung bei KI Beschleunigung um 1 Mllion gegenüber heute..

in 5 Jahren haben wir alle son ding permanentn im Handy laufen.

Damit ist wohl klar dass ich demächst bestellen muss.

ja mit dem voice part bin ich auch noch am rumprobieren.

Interessant (und damit auch legally mindestens grey) wirds dann damit:

https://github.com/serp-ai/bark-with-voice-clone

Endlich mehr Hörbücher gelesen von Detlef Bierstedt

Aber mein Vorhaben ist auf jedenfall machbar.

Interesant wirds wenn ich versuche deutsche Hörbücher aus Büchern zu erstellen die es nur auf englisch gibt.

Zum Thema ressourcenverbrauch.

Letztens noch was von nvidia gelesen, Sie erwarten bis 2030, durch verbesserungen in hardware, software und dem ganzen Ökosystem eine Verbesserung bei KI Beschleunigung um 1 Mllion gegenüber heute..

in 5 Jahren haben wir alle son ding permanentn im Handy laufen.

-

PSN-Name: Der_Hutmacher

Sehr geil! Vielen Dank.

Damit ist wohl klar dass ich demnächst bestellen muss.

Damit ist wohl klar dass ich demnächst bestellen muss.

Aktuell ist die einzige Einschränkung die Anzahl der Tokens pro Prompt/Output, welche man mitgeben kann. Da muss man dann teilweise möglicherweise die Prompts auf mehrere Segmente aufteilen.

Ja aktuell ist es schon verrückt, wie sich das alles entwickelt. Letztens habe ich ein Video gesehen, wo jemand einen kleinen Roboter mit GPT-4 + Speech Recognition ausgestattet hatte. Ich kann mir auch vorstellen, dass es irgendwann spezielle Hardware/Chips die darauf ausgelegt sind geben wird, mit denen solche LLMs lokal auf kleineren Geräten laufen können, welche dann auch in abgespeckter Version auch ohne Cloud Anbindung funktionieren und vielleicht mit einem Cache der letzten Abfragen weiterarbeiten können.

-

PSN-Name: BillMorisson

-

Spielt gerade: FF VII Remake